Llama架构比不上GPT2?神奇token提升10倍记忆?

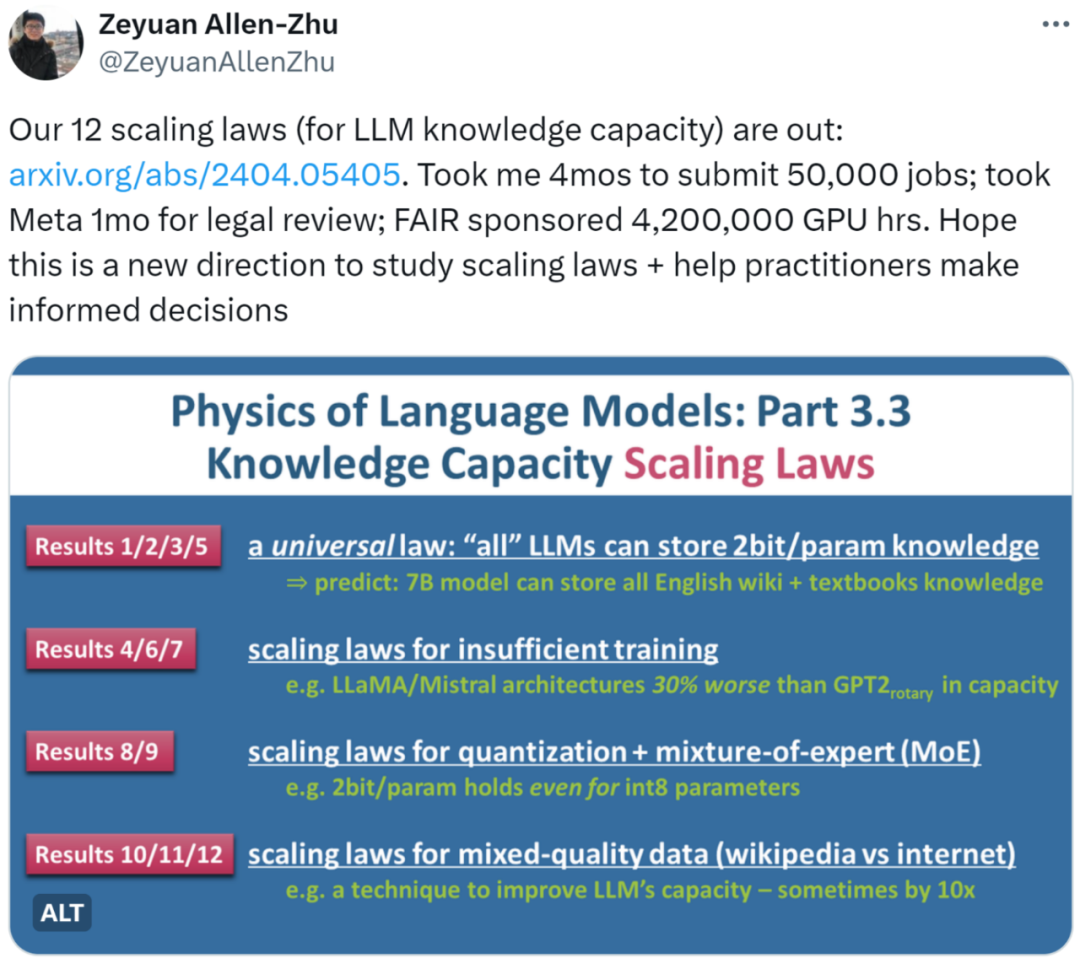

Llama架构比不上GPT2?神奇token提升10倍记忆?近日,朱泽园 (Meta AI) 和李远志 (MBZUAI) 的最新研究《语言模型物理学 Part 3.3:知识的 Scaling Laws》用海量实验(50,000 条任务,总计 4,200,000 GPU 小时)总结了 12 条定律,为 LLM 在不同条件下的知识容量提供了较为精确的计量方法。

近日,朱泽园 (Meta AI) 和李远志 (MBZUAI) 的最新研究《语言模型物理学 Part 3.3:知识的 Scaling Laws》用海量实验(50,000 条任务,总计 4,200,000 GPU 小时)总结了 12 条定律,为 LLM 在不同条件下的知识容量提供了较为精确的计量方法。

这次,谷歌要凭「量」打败其他竞争对手。 当地时间本周二,谷歌在 Google’s Cloud Next 2024 上发布了一系列 AI 相关的模型更新和产品,包括 Gemini 1.5 Pro 首次提供了本地音频(语音)理解功能、代码生成新模型 CodeGemma、首款自研 Arm 处理器 Axion 等等。

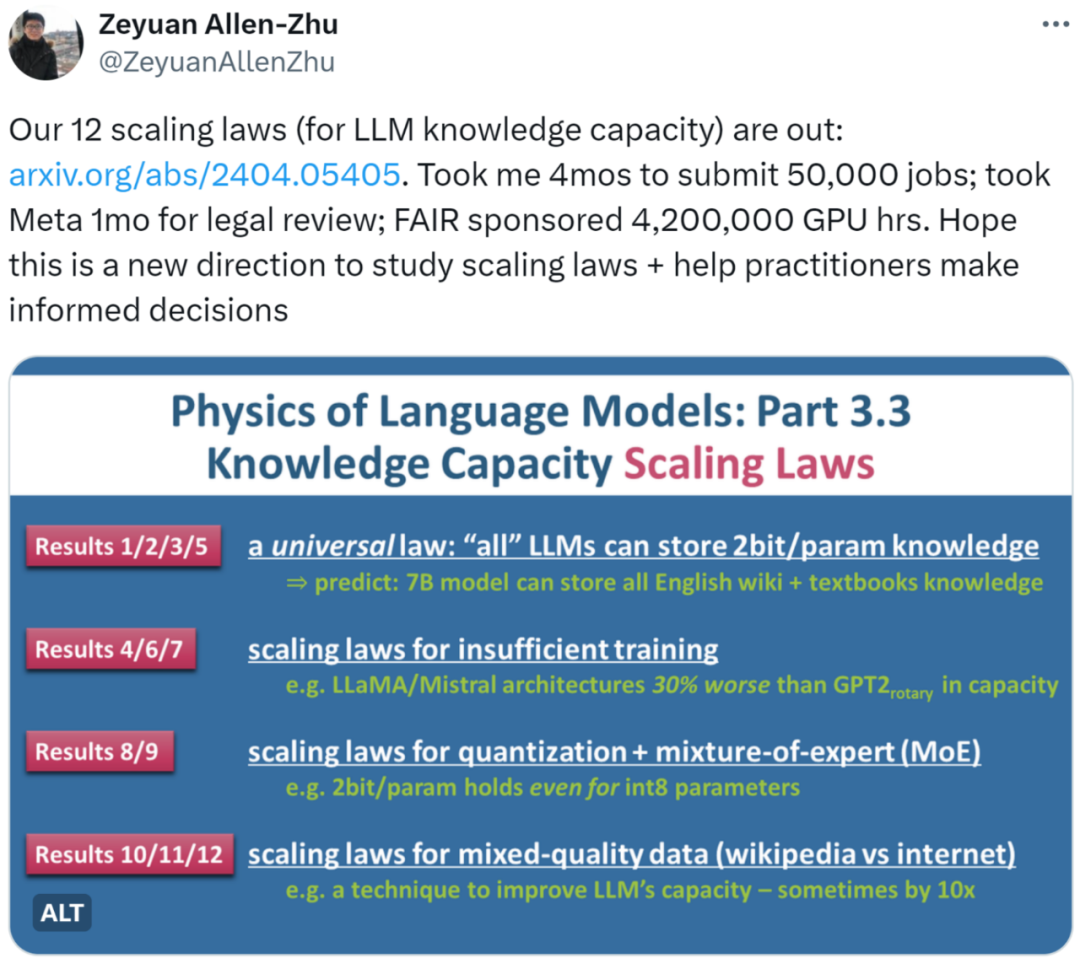

随着AI技术的广泛应用,从智能手机到自动驾驶汽车,从智能家居到工业自动化,AI供电芯片的需求量正呈爆炸式增长。它不仅为AI系统提供稳定的电力供应,确保系统的正常运行,而且还肩负着节能减排、降低能耗的重任。

上个月,彭博社消息称苹果正在与 Google 进行谈判,希望将 Gemini 集成的 iPhone 当中,为 iPhone 的软件提供 AI 相关的新功能。把新系统的核心功能“外包”给第三方,这种做法非常不苹果。

Stability AI推出Stable LM 2 12B模型,作为其新模型系列的进一步升级,该模型基于七种语言的2万亿Token进行训练,拥有更多参数和更强性能,据称在某些基准下能超越Llama 2 70B。

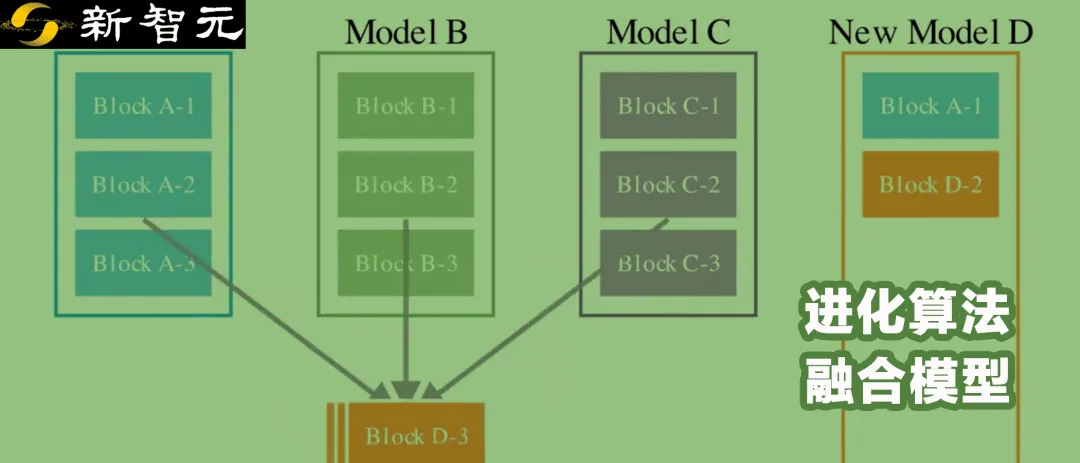

自动将不同开源模型进行组合,生成具有新能力的新模型,Sakana AI开发的新方法做到了!

在这个风起云涌的 AI 时代,一场前所未有的资本军备竞赛正在火热上演。算力、算法、数据,这些被视为 AI 领域的三大基石,正成为各大公司争夺的焦点。然而,在这场看似技术驱动的竞赛背后,低成本资金的获取却成为了决定胜负的隐形推手。

中国领先的 Data Centric AI 赋能平台及解决方案服务商

在大模型落地应用的过程中,端侧 AI 是非常重要的一个方向。近日,斯坦福大学研究人员推出的 Octopus v2 火了,受到了开发者社区的极大关注,模型一夜下载量超 2k。20 亿参数的 Octopus v2 可以在智能手机、汽车、个人电脑等端侧运行,在准确性和延迟方面超越了 GPT-4,并将上下文长度减少了 95%。此外,Octopus v2 比 Llama7B + RAG 方案快 36 倍。

2024 年英伟达 GTC 大会上,创始人兼 CEO 黄仁勋以人形机器人压轴,并表示构建通用人形机器人的基本模型是今天能在 AI 领域解决的最令人兴奋的问题之一